Claude用户注意:聊天历史记录将用于人工智能培

栏目:行业动态 发布时间:2025-09-14 10:25

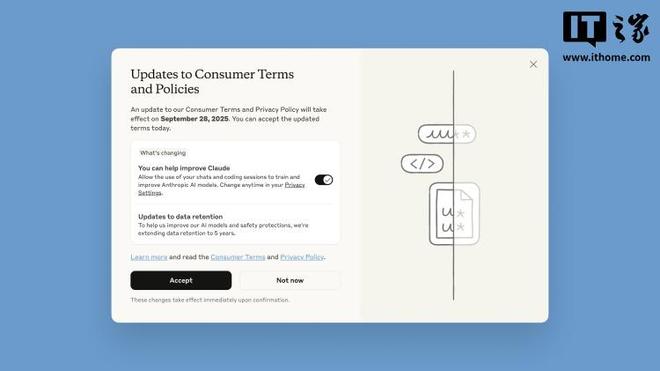

这是在8月29日新闻的家中,拟人化宣布,它将开始使用用户数据培训AI模型,其中包括新的聊天写作会话和代码写作会话,除非积极选择用户。同时,该公司还扩大了五年的数据维护政策,这也适用于尚未选择的用户。根据周四发表的拟人博客文章,所有用户都必须在9月28日进行选择。如果用户现在单击“接受”,则拟人化将立即开始使用其数据训练该模型并将数据维护长达五年。此设置仅适用于“新或重新打开的聊天和代码写作会话”。尽管使用人类使用其数据来培训模型的用户不包括培训范围内用户未打开的历史聊天或代码会话。但是,一旦用户继续使用旧会话,基于数据的数据将包含在练习中。人类在文章中指出,此更新涵盖了Claude的所有订阅层,包括Claude Free Edition,Pro Edition和Premium Edition(Max),“当用户通过订阅上述订阅使用Claude代码时,同样适用。”但是,此更新不适用于人类层次结构的商业用途,例如Claude Gov,Enterprise Edition和Edition Edition,也不适用于API呼叫场景,包括通过亚马逊BedRock和Google Cloud Vertex等第三方平台使用API来确认proyence persiences persiences clainsclaude conso popso copso propso copso copso forso copso for noce opso propso''都可以选择范围。设置“以推迟该决定的按钮,但是选择必须在9月28日之前完成。应该注意的是,许多用户可以快速单击“接受”而无需仔细阅读条款和内容。在用户会看到的弹出窗口中,大字体显示“消费者术语”and Policy Updates", and the text below states "Our consumer terms and privacy policy updates will be effective on September 28, 2025, you can accept updated terms today". There is a known black "accept" button under the pop-up window. Home noticed that in the small word section below the button, there were many lines of text that readof "Allow your chat and code history to write sessions for training and improving anthropical AI models", with an on/off toggle next to it, and in默认情况下,“在”状态。选项可以改变他们的CHOICE在任何时间通过隐私设置,但是新设置将来只会在DAT组合中生效 - 用于模型培训的数据无法撤消。 Anthropic在博客文章中说:“为了保护用户的隐私,我们将许多工具和自动流程结合在一起,以过滤或淡淡的敏感数据。我们不会在第三方出售用户数据。”

特别声明:上面的内容(包括照片或视频(如果有))已由“ NetEase”自助媒体平台的用户上传和发布。该平台仅提供信息存储服务。

注意:上面的内容(包括照片和视频(如果有))已由NetEase Hao用户上传和发布,该用户是社交媒体平台,仅提供信息存储服务。

这是在8月29日新闻的家中,拟人化宣布,它将开始使用用户数据培训AI模型,其中包括新的聊天写作会话和代码写作会话,除非积极选择用户。同时,该公司还扩大了五年的数据维护政策,这也适用于尚未选择的用户。根据周四发表的拟人博客文章,所有用户都必须在9月28日进行选择。如果用户现在单击“接受”,则拟人化将立即开始使用其数据训练该模型并将数据维护长达五年。此设置仅适用于“新或重新打开的聊天和代码写作会话”。尽管使用人类使用其数据来培训模型的用户不包括培训范围内用户未打开的历史聊天或代码会话。但是,一旦用户继续使用旧会话,基于数据的数据将包含在练习中。人类在文章中指出,此更新涵盖了Claude的所有订阅层,包括Claude Free Edition,Pro Edition和Premium Edition(Max),“当用户通过订阅上述订阅使用Claude代码时,同样适用。”但是,此更新不适用于人类层次结构的商业用途,例如Claude Gov,Enterprise Edition和Edition Edition,也不适用于API呼叫场景,包括通过亚马逊BedRock和Google Cloud Vertex等第三方平台使用API来确认proyence persiences persiences clainsclaude conso popso copso propso copso copso forso copso for noce opso propso''都可以选择范围。设置“以推迟该决定的按钮,但是选择必须在9月28日之前完成。应该注意的是,许多用户可以快速单击“接受”而无需仔细阅读条款和内容。在用户会看到的弹出窗口中,大字体显示“消费者术语”and Policy Updates", and the text below states "Our consumer terms and privacy policy updates will be effective on September 28, 2025, you can accept updated terms today". There is a known black "accept" button under the pop-up window. Home noticed that in the small word section below the button, there were many lines of text that readof "Allow your chat and code history to write sessions for training and improving anthropical AI models", with an on/off toggle next to it, and in默认情况下,“在”状态。选项可以改变他们的CHOICE在任何时间通过隐私设置,但是新设置将来只会在DAT组合中生效 - 用于模型培训的数据无法撤消。 Anthropic在博客文章中说:“为了保护用户的隐私,我们将许多工具和自动流程结合在一起,以过滤或淡淡的敏感数据。我们不会在第三方出售用户数据。”

特别声明:上面的内容(包括照片或视频(如果有))已由“ NetEase”自助媒体平台的用户上传和发布。该平台仅提供信息存储服务。

注意:上面的内容(包括照片和视频(如果有))已由NetEase Hao用户上传和发布,该用户是社交媒体平台,仅提供信息存储服务。